ניתן ורצוי (במרבית המקרים) למנוע ממנועי חיפוש מלהוסיף לאינדקס את עמודי תוצאות החיפוש באתר הוורדפרס שלכם. עמודים אלו לא מציעים ערך ייחודי לגולשים, והוספתם לאינדקס מבזבזת תקציב זחילה שיכול להיות מושקע בעמודים חשובים יותר.

אם לא מטפלים בכך, כתובות תוצאות החיפוש עלולות להופיע גם בדוח האינדקס של Google Search Console כעמודים מאונדקסים, מה שמזהם את הנתונים בכתובות חסרות ערך.

robots.txt מול noindex: במה להשתמש?

ישנן שתי גישות נפוצות לחסימת עמודי תוצאות חיפוש, וחשוב להבין את ההבדל ביניהן.

robots.txt Disallow – מונע ממנועי חיפוש לזחול לכתובת ה-URL. אולם, הוא לא מונע אינדוקס. אם גוגל מוצאת קישור לכתובת חסומה בעמוד אחר, היא עשויה לאנדקס אותה – לעיתים עם ההודעה "תיאור לתוצאה זו אינו זמין בשל קובץ robots.txt של האתר."

תגית noindex – מורה למנועי חיפוש לא לאנדקס את העמוד. זו הדרך הוודאית לשמור על עמוד מחוץ לתוצאות החיפוש, אך היא דורשת שהעמוד יהיה ניתן לזחילה כדי שהבוט יוכל לקרוא את התגית.

עבור עמודי תוצאות חיפוש בוורדפרס, שימוש ב-

Disallowב-robots.txt הוא הבחירה המעשית. עמודים אלו כמעט ולא מקושרים מאתרים חיצוניים, כך שהסיכון שיאונדקסו למרות חוק ה-Disallow נמוך מאוד. Yoast SEO ו-Rank Math משתמשים בגישה זו.

חסימת תוצאות חיפוש באמצעות robots.txt

הוסיפו את ההוראות הבאות לקובץ robots.txt הנמצא בתיקייה הראשית של האתר. הנחיות אלו מניחות שלא שיניתם את מבנה כתובות החיפוש ברירת המחדל של וורדפרס:

User-agent: *

Disallow: /?s=

Disallow: /search/

החוק הראשון חוסם את פורמט כתובת החיפוש ברירת המחדל של וורדפרס (/?s=query). השני חוסם את פורמט ה-"pretty" URL (/search/query) שחלק מהתבניות או התוספים משתמשים בו.

חסימת תוצאות חיפוש באמצעות Yoast SEO

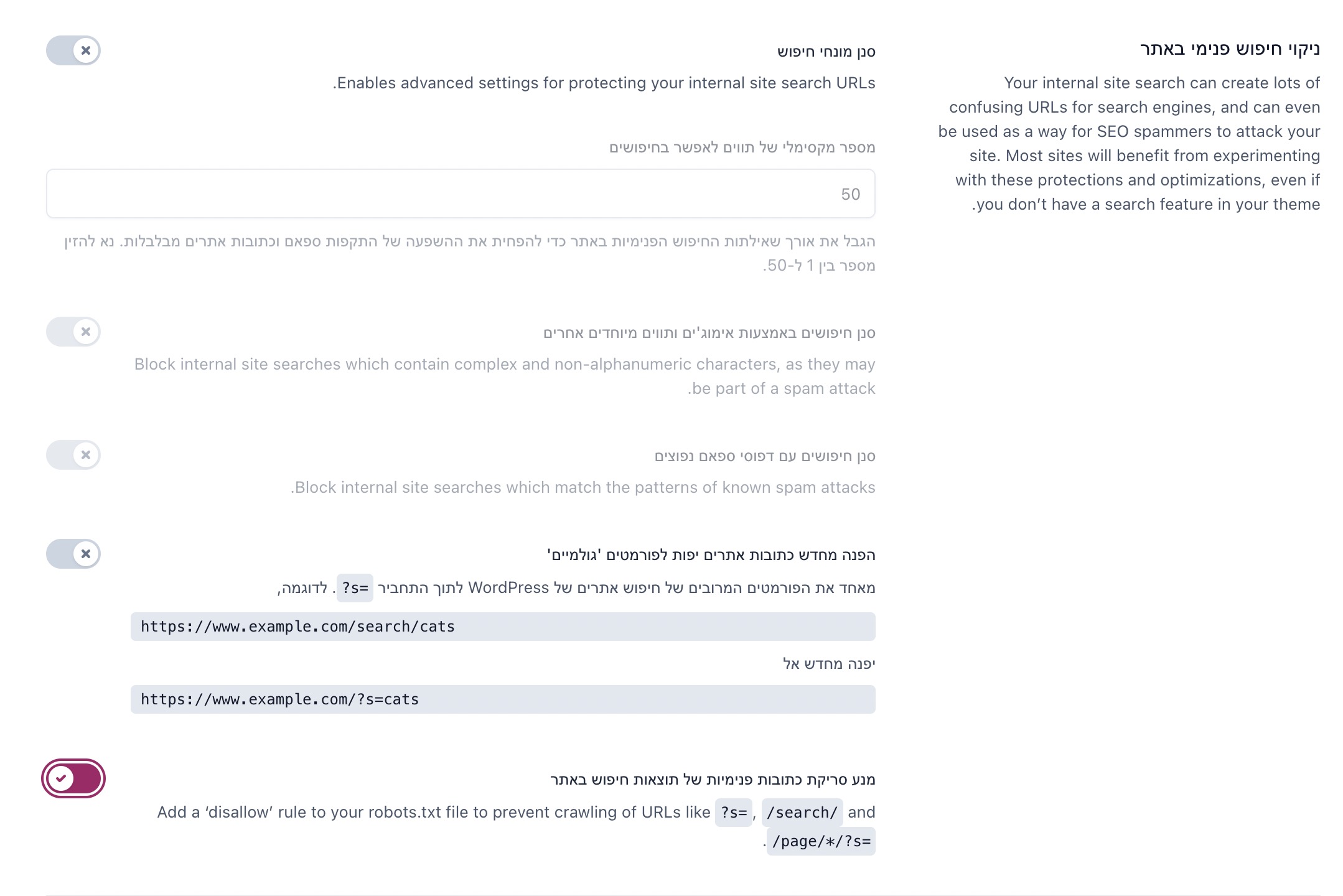

אם אתם משתמשים בתוסף Yoast SEO, ניתן לבצע זאת דרך ממשק הניהול ללא צורך בעריכת קבצים. גשו ל-Yoast SEO > הגדרות > מתקדם > אופטימיזציית סריקה.

תחת הסקשן "ניקוי חיפוש פנימי באתר", הפעילו את האפשרות "מנע סריקת כתובות פנימיות של תוצאות חיפוש באתר". Yoast יוסיף אוטומטית את חוקי ה-Disallow הנדרשים לקובץ robots.txt הווירטואלי.

Yoast מציע אפשרויות נוספות בסקשן זה: סינון ביטויי חיפוש ספאמיים והפניית כתובות חיפוש "pretty" לפורמט הגולמי. שניהם מסייעים בהגנה על האתר מפני התקפות ספאם SEO שמנצלות חיפוש פנימי ליצירת כתובות ספאמיות מאונדקסות.

הוספת noindex כשכבת הגנה נוספת (אופציונלי)

להגנה מקסימלית, ניתן להוסיף תגית noindex לעמודי תוצאות החיפוש לצד חוק ה-robots.txt. הוסיפו את הקוד הבא לקובץ functions.php של התבנית:

add_action( 'wp_head', function() {

if ( is_search() ) {

echo '<meta name="robots" content="noindex, nofollow">';

}

} );כך מבטיחים שגם אם עמוד תוצאות חיפוש נזחל (למשל, לפני שהוספתם את חוק ה-robots.txt), הוא עדיין ישא הנחיית noindex.

שאלות נפוצות

שאלות נפוצות על חסימת עמודי תוצאות חיפוש בוורדפרס מאינדוקס:

Disallow ב-robots.txt באמת מונע אינדוקס?

Disallow ב-robots.txt מונע זחילה, לא אינדוקס. אם גוגל מוצאת קישור לכתובת חסומה במקום אחר, היא יכולה לאנדקס את הכתובת מבלי לזחול אליה. עבור תוצאות חיפוש בוורדפרס, זו בעיה נדירה מכיוון שעמודים אלו כמעט ולא מקושרים חיצונית. להסרה מובטחת מתוצאות החיפוש, השתמשו בתגית noindex.Disallow ב-robots.txt מספיק. הוספת תגית noindex היא שכבת הגנה נוספת אופציונלית. שימו לב שאם חוסמים כתובת דרך robots.txt וגם מוסיפים noindex, מנועי חיפוש עלולים לא לראות את תגית ה-noindex מכיוון שהם לא יכולים לזחול לעמוד. בפועל, שימוש עקבי בשיטה אחת מספיק.Disallow. Rank Math גם מאפשר להגדיר noindex על עמודי חיפוש כברירת מחדל תחת Titles & Meta > Misc Pages > Search Results.Disallow, גוגל תפסיק לזחול לכתובות אלו. עמודים שכבר מאונדקסים ייפלו מהאינדקס בהדרגה עם הזמן. כדי להאיץ את ההסרה, השתמשו בכלי הסרת כתובות ב-Google Search Console או הוסיפו תגית noindex (מה שדורש הסרה זמנית של חוק ה-Disallow כדי שגוגל תוכל לזחול ולקרוא את התגית).סיכום

עמודי תוצאות חיפוש בוורדפרס לא צריכים להיות מאונדקסים על ידי מנועי חיפוש. הפתרון הפשוט ביותר הוא הוספת Disallow: /?s= ו-Disallow: /search/ לקובץ robots.txt, או הפעלת הגדרת אופטימיזציית הסריקה ב-Yoast SEO. לשכבת הגנה נוספת, הוסיפו תגית noindex דרך functions.php.